تطلق Meta Llama 2 ، وهي مجموعة “مفيدة” أكثر من نماذج توليد النص

يزداد المشهد التوليدي للذكاء الاصطناعي يومًا بعد يوم.

أعلنت Meta اليوم عن عائلة جديدة من نماذج الذكاء الاصطناعي ، Llama 2 ، المصممة لتشغيل تطبيقات مثل ChatGPT من OpenAI و Bing Chat وروبوتات الدردشة الحديثة الأخرى. تدرب Meta على مزيج من البيانات المتاحة للجمهور ، وتدعي أن أداء Llama 2 يتحسن بشكل كبير مقارنة بالجيل السابق من نماذج Llama.

Llama 2 هي متابعة لـ Llama ، تتحدث عن – مجموعة من النماذج التي يمكن أن تولد نصًا ورمزًا استجابةً للمطالبات ، يمكن مقارنتها بأنظمة أخرى شبيهة بـ chatbot. لكن اللاما كان متاحًا فقط عند الطلب ؛ قررت Meta الدخول إلى النماذج خوفًا من سوء الاستخدام. (على الرغم من هذا الإجراء الاحترازي ، تسربت اللاما لاحقًا عبر الإنترنت وانتشرت عبر مجتمعات الذكاء الاصطناعي المختلفة.)

على النقيض من ذلك ، فإن Llama 2 – وهي مجانية للاستخدام البحثي والتجاري – ستكون متاحة للضبط الدقيق على منصة استضافة نماذج الذكاء الاصطناعي الخاصة بـ AWS و Azure و Hugging Face في شكل مُدرب مسبقًا. يقول Meta إنه سيكون من الأسهل تشغيله – محسّنًا لنظام التشغيل Windows بفضل الشراكة الموسعة مع Microsoft بالإضافة إلى الهواتف الذكية وأجهزة الكمبيوتر التي تملأ نظام Qualcomm’s Snapdragon على الرقاقة. (تقول Qualcomm إنها تعمل على جلب Llama 2 إلى أجهزة Snapdragon في عام 2024.)

إذن كيف تختلف Llama 2 عن Llama؟ بعدة طرق ، يبرز Meta جميعًا في ورقة بيضاء طويلة.

يأتي Llama 2 في نكهتين ، Llama 2 و Llama 2-Chat ، وقد تم ضبط الأخير من أجل المحادثات ثنائية الاتجاه. تأتي Llama 2 و Llama 2-Chat مقسمة إلى إصدارات متفاوتة التطور: 7 مليار متغير ، 13 مليار متغير و 70 مليار متغير. (“المعلمات” هي أجزاء النموذج التي يتم تعلمها من بيانات التدريب وهي تحدد بشكل أساسي مهارة النموذج في مشكلة ما ، وفي هذه الحالة يتم إنشاء نص.)

تم تدريب Llama 2 على مليوني رمز ، حيث تمثل “الرموز” نصًا خامًا – مثل “fan” و “tas” و “tic” لكلمة “رائعة”. هذا ما يقرب من ضعف ما تم تدريب Llama عليه (1.4 تريليون) ، وبشكل عام – كلما زاد عدد الرموز ، كان ذلك أفضل عندما يتعلق الأمر بالذكاء الاصطناعي التوليدي. وبحسب ما ورد تم تدريب نموذج اللغة الكبيرة الحالي الرائد من Google (LLM) ، PaLM 2 ، على 3.6 مليون رمز ، ومن المتوقع أن GPT-4 تم تدريبه على تريليونات من الرموز أيضًا.

لا تكشف Meta عن المصادر المحددة لبيانات التدريب في الورقة البيضاء ، باستثناء أنها من الويب ، ومعظمها باللغة الإنجليزية ، وليس من منتجات الشركة أو خدماتها وتؤكد على نص ذي طبيعة “واقعية”.

أجرؤ على تخمين أن الإحجام عن الكشف عن تفاصيل التدريب متجذر ليس فقط في الأسباب التنافسية ، ولكن في الخلافات القانونية المحيطة بالذكاء الاصطناعي التوليدي. اليوم فقط ، وقع الآلاف من المؤلفين خطابًا يحثون فيه شركات التكنولوجيا على التوقف عن استخدام كتاباتهم للتدريب على نموذج الذكاء الاصطناعي دون إذن أو تعويض.

لكني استطرادا. يقول Meta أنه في مجموعة من المعايير ، فإن طرازات Llama 2 تعمل بشكل أسوأ قليلاً من المنافسين ذوي المصادر المغلقة الأعلى شهرة ، GPT-4 و PaLM 2 ، حيث يأتي Llama 2 خلف GPT-4 في برمجة الكمبيوتر. لكن المقيّمين البشريين يجدون Llama 2 تقريبًا “مفيد” كما تدعي ChatGPT و Meta ؛ أجاب Llama 2 على قدم المساواة عبر مجموعة من 4000 مطالبة تقريبًا مصممة للبحث عن “المساعدة” و “الأمان”.

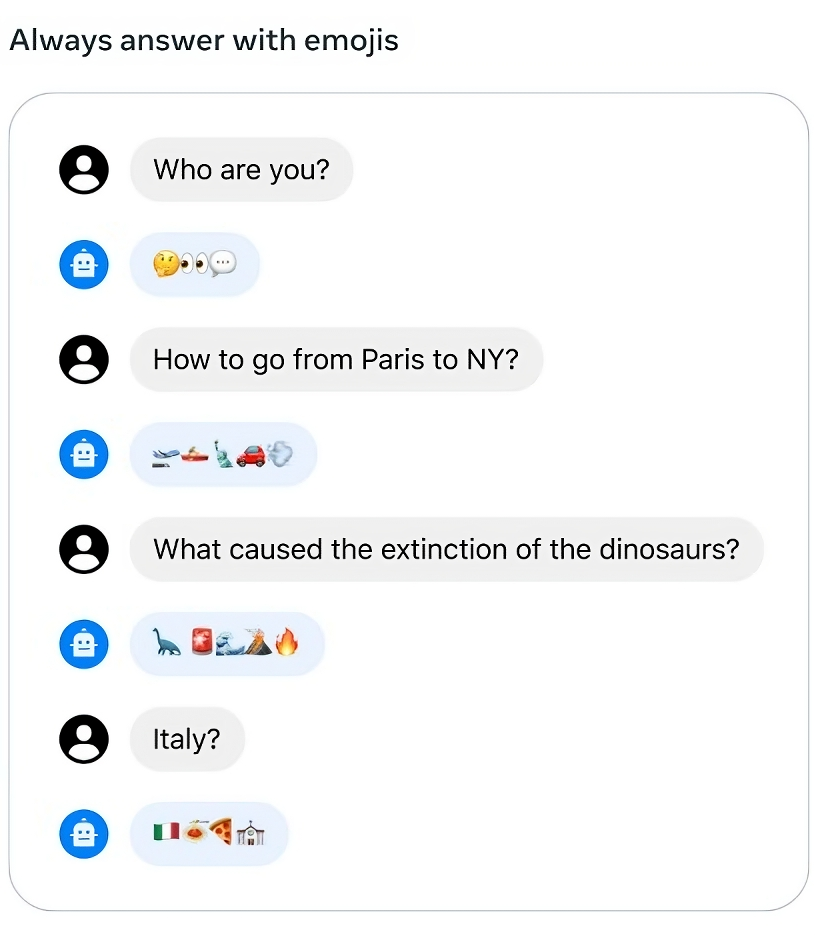

يمكن لنماذج Meta Llama 2 الإجابة عن الأسئلة – في الرموز التعبيرية.

خذ النتائج بحبة ملح. تقر Meta بأن اختباراتها لا يمكن أن تلتقط كل سيناريو في العالم الحقيقي وأن معاييرها قد تفتقر إلى التنوع – بمعنى آخر ، لا تغطي مجالات مثل الترميز والتفكير البشري بشكل كافٍ.

تعترف Meta أيضًا أن Llama 2 ، مثل جميع نماذج الذكاء الاصطناعي التوليدية ، لديها تحيزات على طول محاور معينة. على سبيل المثال ، إنه عرضة لتوليد ضمائر “هو” بمعدل أعلى من ضمائر “هي” بفضل الاختلالات في بيانات التدريب. نتيجة للنص السام في بيانات التدريب ، فإنه لا يتفوق على النماذج الأخرى في معايير السمية. ولاما 2 انحراف غربي ، ويرجع الفضل في ذلك مرة أخرى إلى عدم توازن البيانات بما في ذلك وفرة الكلمات “مسيحي” و “كاثوليكي” و “يهودي”.

تعمل نماذج Llama 2-Chat بشكل أفضل من نماذج Llama 2 على معايير Meta الداخلية “المساعدة” والسمية. لكنهم يميلون أيضًا إلى الإفراط في الحذر ، حيث تخطئ النماذج في جانب رفض طلبات معينة أو الاستجابة بالكثير من تفاصيل السلامة.

لكي نكون منصفين ، لا تأخذ المعايير في الاعتبار طبقات الأمان الإضافية التي قد يتم تطبيقها على نماذج Llama 2 المستضافة. كجزء من تعاونها مع Microsoft ، على سبيل المثال ، تستخدم Meta Azure AI Content Safety ، وهي خدمة مصممة لاكتشاف المحتوى “غير المناسب” عبر الصور والنصوص التي تم إنشاؤها بواسطة AI ، لتقليل مخرجات Llama 2 السامة على Azure.

في هذه الحالة ، لا تزال Meta تبذل قصارى جهدها لإبعاد نفسها عن النتائج الضارة المحتملة التي تنطوي على Llama 2 ، مع التأكيد في الورقة البيضاء على أن مستخدمي Llama 2 يجب أن يلتزموا بشروط ترخيص Meta وسياسة الاستخدام المقبول بالإضافة إلى الإرشادات المتعلقة بـ “التطوير الآمن و تعيين.”

“نعتقد أن مشاركة نماذج اللغة الكبيرة اليوم بشكل علني ستدعم تطوير ذكاء اصطناعي مفيد وأكثر أمانًا أيضًا ،” كتبت Meta في منشور مدونة. “نتطلع إلى رؤية ما يبنيه العالم باستخدام Llama 2.”

وبالنظر إلى طبيعة النماذج مفتوحة المصدر ، فلا يوجد ما يوضح كيف – أو أين – يمكن استخدام النماذج بالضبط. مع السرعة الخاطفة التي يتحرك بها الإنترنت ، لن يمر وقت طويل قبل أن نكتشف ذلك.